Se hai guardato i video di lancio di Adobe MAX 2020, probabilmente hai notato che si sono formate alcune tendenze durante le demo dei prodotti.

Mobile e social erano (e saranno sempre) punti focali, ma Intelligenza Artificiale (AI) e Machine Learning (ML) — o Sensei poiché Adobe ha scelto di marchiarli, è salito sul palco in diversi modi sorprendenti.

Come sempre, gran parte del tempo di trasmissione è stato dedicato a Photoshop, che ha aggiunto un pacchetto di strumenti basati su Sensei chiamati Filtri neurali che includono l'upscaling dell'immagine, la sostituzione del cielo e l'invecchiamento del ritratto. Ma mentre girare l'orologio in avanti sul tuo viso è divertente e scambiare quello skyline sbalordito con un tramonto di serie rende un paesaggio più bello, è difficile vedere molto valore commerciale in questi strumenti. Per questo, dovresti guardare la funzione di intelligenza artificiale meno discussa in Premiere Pro:la sintesi vocale.

Diamo un'occhiata al motivo per cui potresti volerlo, come potresti usarlo e se questo strumento di apprendimento automatico può aumentare la tua produttività.

Non ne parliamo

Prendiamoci un momento per ricordare che questo non è il primo tentativo di Adobe di rilasciare uno strumento per convertire l'audio registrato in testo modificabile. L'analisi vocale è stata aggiunta a Premiere Pro nel 2013. Non è stato fantastico.

Quando l'ho testato allora, la migliore descrizione per i risultati che ha prodotto sarebbe insalata di parole.

Ma per essere onesti, lo stesso valeva anche per altri software in quel momento. La trascrizione automatica di Google per i video di YouTube era altrettanto inaffidabile. Come ha affermato un commentatore "secondo la mia esperienza, fa un lavoro così pessimo che il tempo che mi ci vorrebbe per correggerlo è considerevolmente più del tempo che mi ci vorrebbe per trascriverlo io stesso".

E questo, in poche parole, era il problema. Quindi non è stato davvero sorprendente che Adobe abbia ritirato Speech Analysis dal rilascio pubblico nel 2014 e sia rimasto in silenzio sull'argomento fino a quando il favoloso Jason Levine l'ha riportato alla ribalta nel 2020.

Tratti diversi

È probabile che la motivazione per la generazione automatica dei sottotitoli dipenda dalla prospettiva della tua attività.

Ad esempio, aziende come Google e Facebook lo vogliono perché rende i video indicizzabili e ricercabili, permettendoci di trovare contenuti all'interno dei video (e per loro di vendere spazi pubblicitari in base al contesto).

Ma per i produttori e distributori di video, la necessità dei sottotitoli probabilmente proviene da un luogo diverso.

Accessibilità

Le leggi sull'accessibilità sono diverse in tutto il mondo, ma le più vicine a uno standard globale sono le Web Content Accessibility Guidelines (WCAG) pubblicate dal World Wide Web Consortium (W3C). Vale la pena notare che la sezione 7.3 delle attuali WCAG indica che i media senza didascalie sono considerati un errore critico che fallisce automaticamente il processo di classificazione.

Negli Stati Uniti, la FCC ha già imposto un requisito legale che tutti i contenuti TV trasmessi in America debbano essere sottotitolati e qualsiasi successivo streaming di questi contenuti rientra nelle stesse regole.

E mentre è vero che i contenuti trasmessi in modo univoco su Internet non rientrano in queste normative, la legislazione, tra cui l'Americans with Disabilities Act (ADA), è già stata utilizzata con successo come base per azioni legali contro piattaforme di streaming come Netflix e Hulu.

Quindi al giorno d'oggi è probabilmente più sicuro presumere che i sottotitoli siano obbligatori per legge nel paese/stato in cui operi piuttosto che scoprirlo nel modo più duro.

Social media

Sebbene soddisfare i requisiti di accessibilità sia un'ottima giustificazione per i sottotitoli, è anche vantaggioso per il pubblico che non soffre di perdita dell'udito, soprattutto quando si tratta di video nei social media.

La riproduzione automatica silenziata sta rapidamente diventando la norma per i video nei feed social a scorrimento e si stima che fino all'85 percento delle visualizzazioni di video avvenga con l'audio disattivato. Quindi, se vuoi migliorare il rapporto segnale/rumore dei tuoi contenuti sui social media, i sottotitoli sono ora una parte essenziale del processo.

Copertura globale

E per quelli di noi che lavorano con i mercati globali, è risaputo da tempo che i sottotitoli sono il modo più semplice per riproporre film e contenuti video per un pubblico che parla una lingua diversa. (Sicuramente molto meno coinvolto del doppiaggio e dell'ADR.)

Mentre alcuni servizi di traduzione possono funzionare direttamente dal supporto originale, offrire un file di sottotitoli nella lingua originale può aiutare a velocizzare il processo.

Ci sono, ovviamente, altri motivi per cui i sottotitoli stanno rapidamente diventando una componente essenziale della produzione dei media, e non è solo a causa dei meme.

Ma mentre le esigenze possono cambiare da un'azienda all'altra, il vantaggio fondamentale è lo stesso:aggiungere i sottotitoli ai tuoi media ti aiuterà a raggiungere un pubblico più ampio. E questo è un bene per tutti .

Iniziamo lo spettacolo

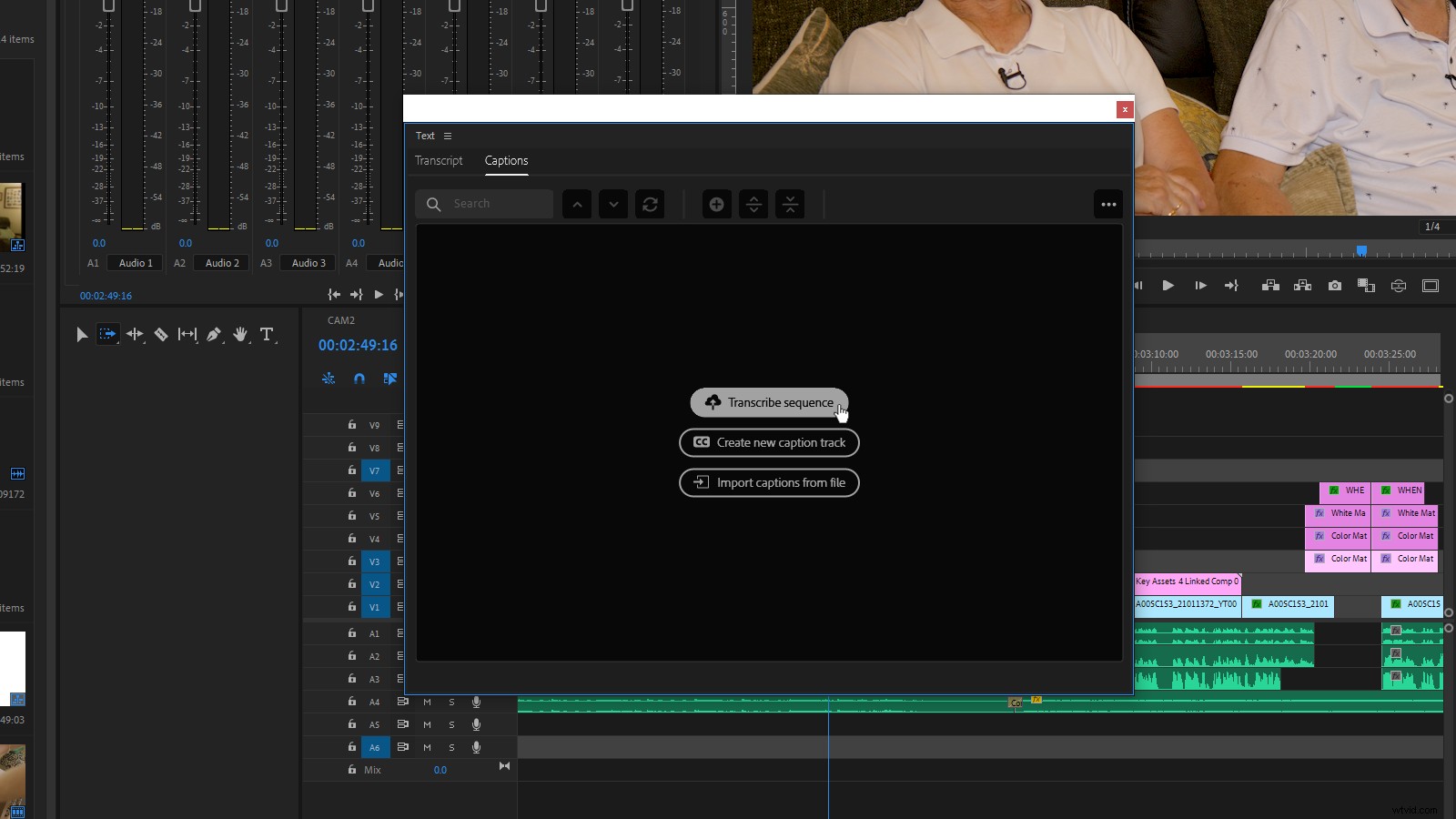

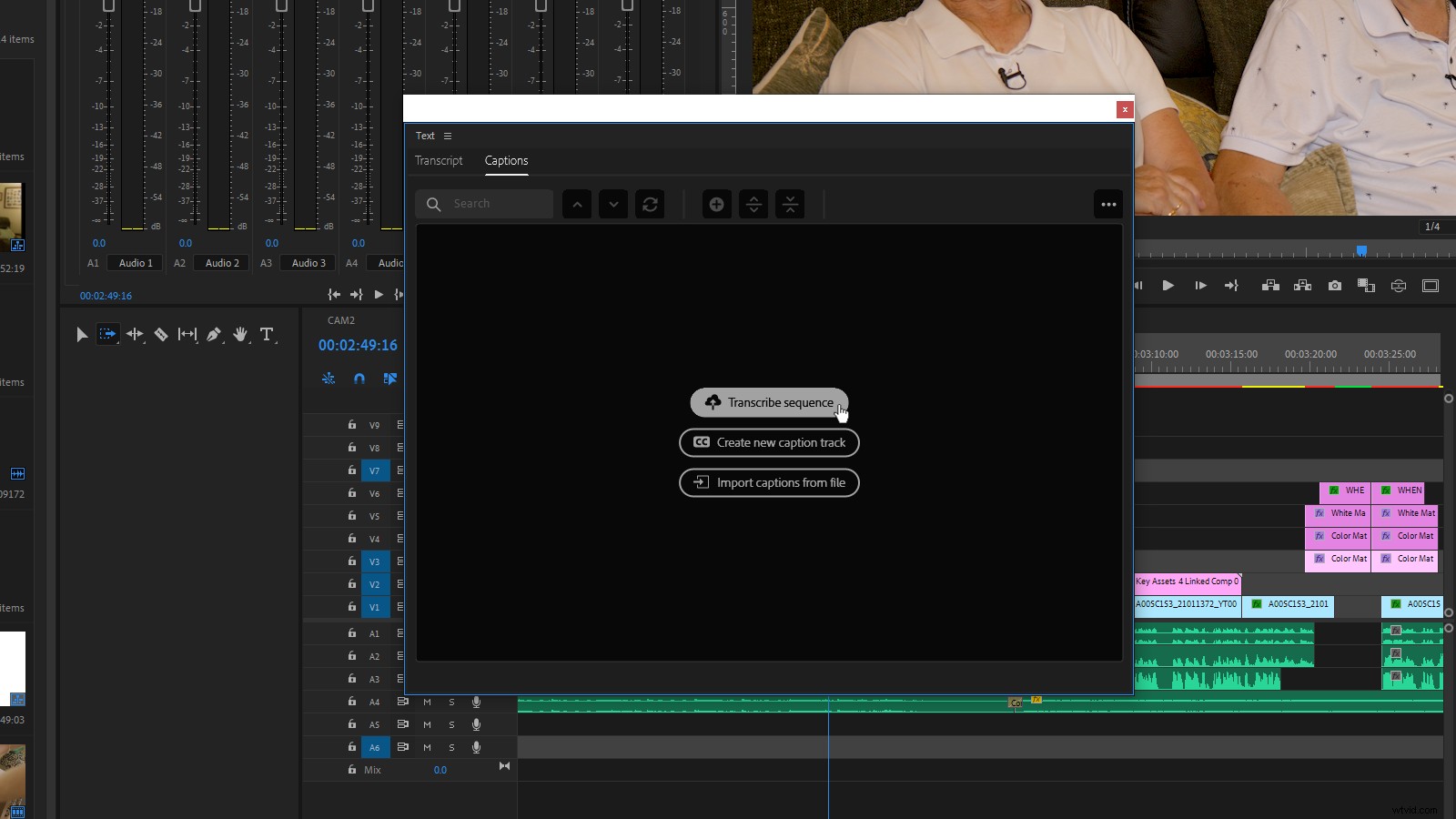

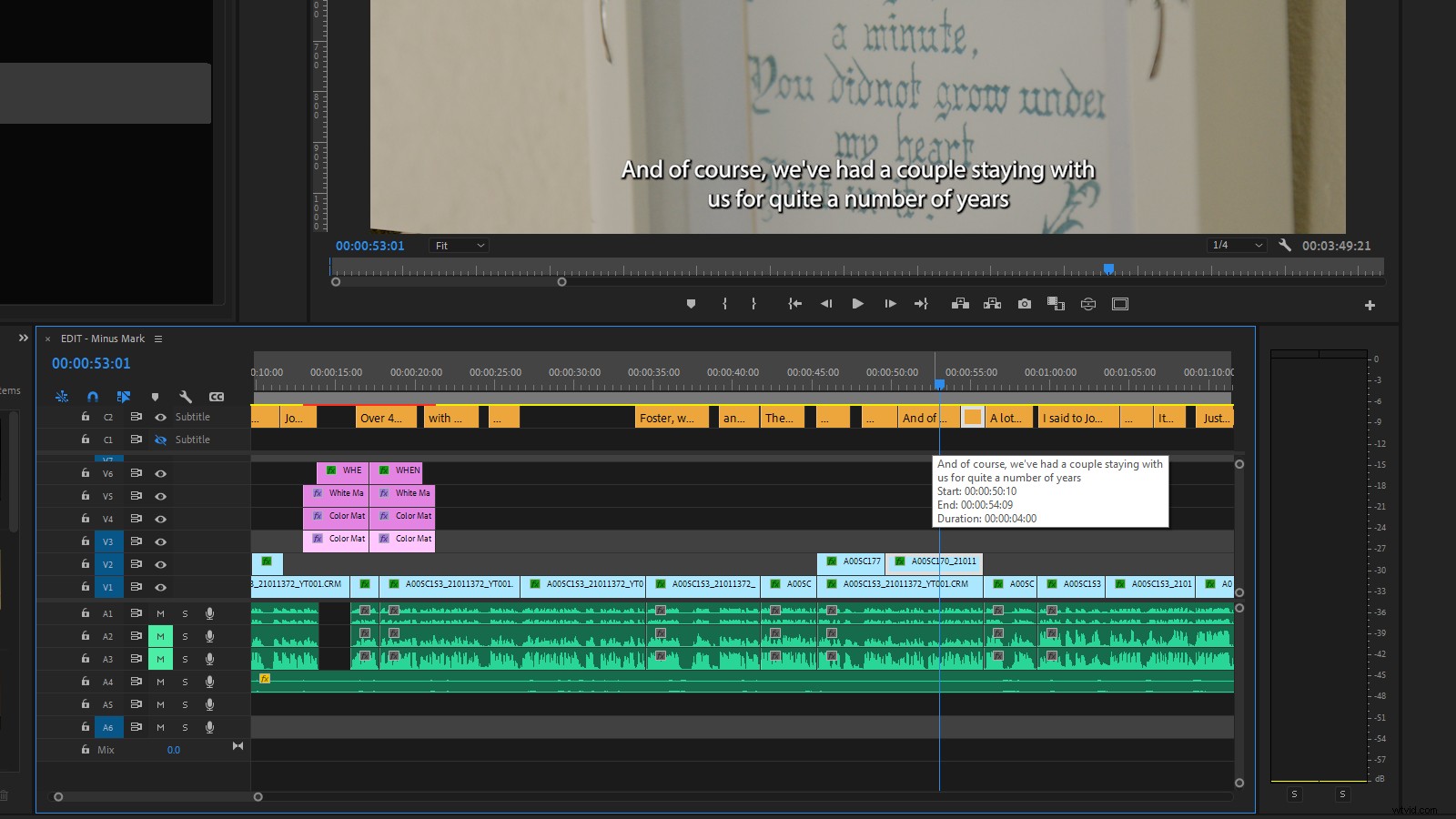

Per iniziare, apri il progetto da inserire nei sottotitoli in Premiere Pro e attiva la sequenza di destinazione nella vista Timeline.

A seconda di come hai strutturato la tua modifica, una piccola quantità di preparazione potrebbe essere utile prima di andare avanti.

Ad esempio, se hai disposto più voci su tracce separate o se hai un mix di voci e SFX/musica sullo stesso traccia, dovresti dedicare un po' di tempo a contrassegnare le clip vocali come Dialogo utilizzando il pannello Audio essenziale (puoi anche scegliere di disattivare l'audio di eventuali tracce indesiderate sulla timeline, se è più semplice). Ciò consentirà a Premiere Pro di sapere quali risorse includere nell'audio esportato che analizza in seguito.

Inoltre, se non si desidera creare didascalie per l'intera sequenza, è necessario impostare i punti di attacco e stacco della sequenza spostando la testina di riproduzione nelle posizioni richieste e premendo rispettivamente i tasti I e O. (Nota che la barra dell'area di lavoro non viene utilizzata per questa funzione.)

Quando sei pronto, apri la finestra Testo (Finestra->Testo) e premi Trascrivi sequenza pulsante.

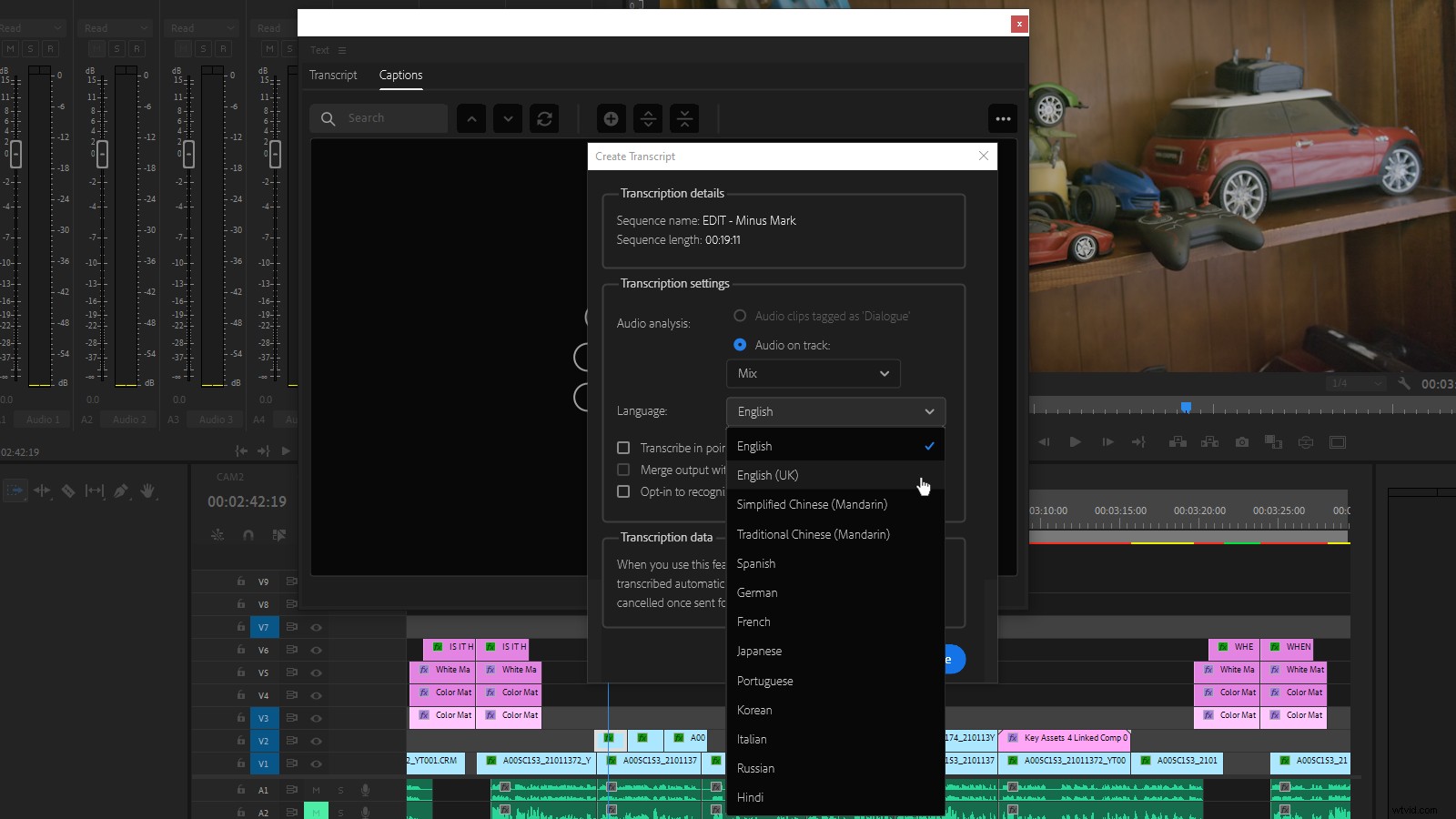

Le tue opzioni a questo punto sono semplici. Puoi scegliere di esportare un mixdown solo delle clip che hai etichettato come Dialogo, puoi selezionare Mix per creare un mixdown dell'intera sequenza oppure puoi selezionare una traccia specifica da esportare dal menu a discesa.

Al momento, non c'è modo di selezionare più tracce audio per il missaggio, il che potrebbe essere fastidioso se hai più altoparlanti su tracce separate. Per ora, disattiva l'audio delle tracce che non desideri includere e scegli l'opzione Mix.

La sintesi vocale supporta un'impressionante selezione di lingue che copre la maggior parte della popolazione mondiale. Le eccezioni degne di nota sono l'arabo, il bengalese e l'indonesiano, ma è interessante vedere le varianti dell'inglese sia negli Stati Uniti che nel Regno Unito. (Come espatriato del Regno Unito che vive in Australia, quest'ultimo ottiene punti bonus con me.) Tuttavia, posso solo commentare l'efficacia dello strumento in inglese.

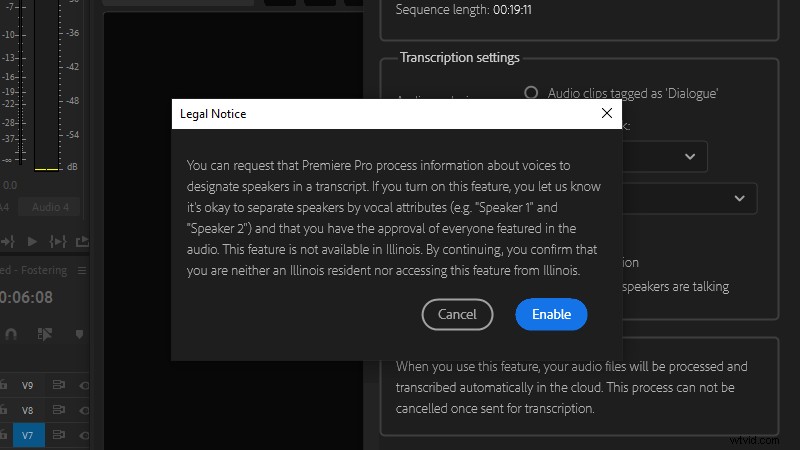

È interessante notare che la capacità di Sensei di identificare diversi parlanti, che era il comportamento predefinito nella versione beta, ora richiede il consenso e non è disponibile in Illinois, presumibilmente a causa di problemi di privacy.

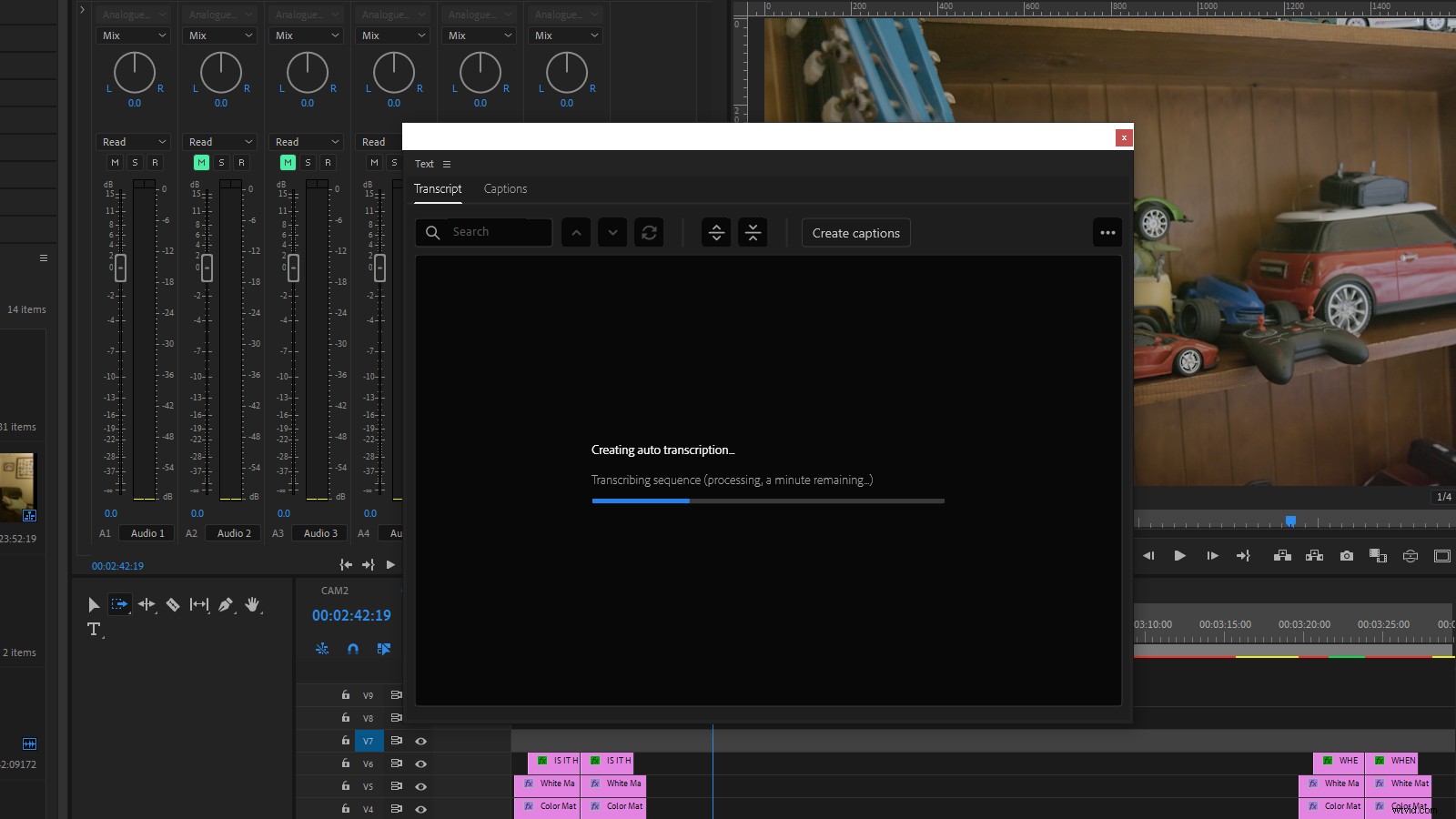

Il processo di trascrizione è relativamente veloce, con un progetto di prova di quattro minuti con due altoparlanti che impiegano circa due minuti e una sequenza di un'ora che richiede 24 minuti, il che indica un tempo di consegna di circa la metà del tempo di esecuzione.

Ma Speech-to-Text è (principalmente) basato su cloud ed è impossibile prevedere quali potrebbero essere le velocità se l'intero abbonamento ad Adobe Creative Cloud inizia improvvisamente a masticare i cicli di elaborazione di Sensei allo stesso tempo. Detto questo, anche se la coda di lavoro diventa necessaria, tu e la tua workstation sarete almeno liberi di fare quel caffè o di recuperare altre attività nel frattempo.

Torna al lavoro

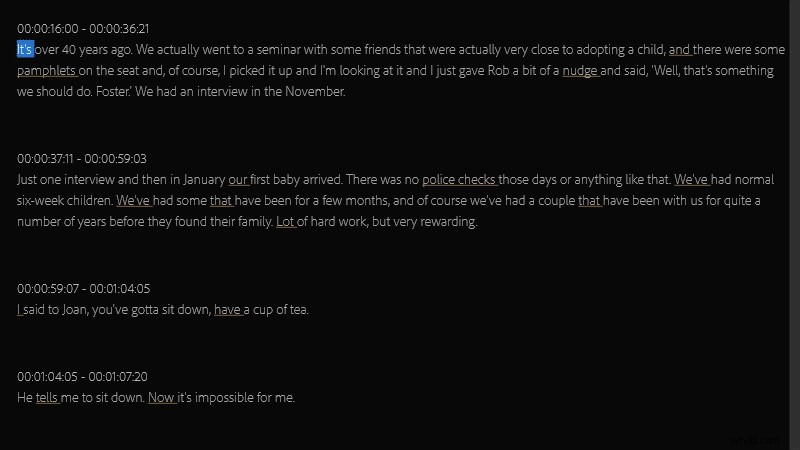

Quando Sensei avrà finito con l'audio, la scheda Trascrizione del pannello Testo verrà popolata con i risultati.

E mentre il tuo chilometraggio può variare, devo dire che sono rimasto colpito dall'accuratezza dei test che ho eseguito. La versione beta che ho testato per la prima volta era buona, la versione pubblica è ancora migliore.

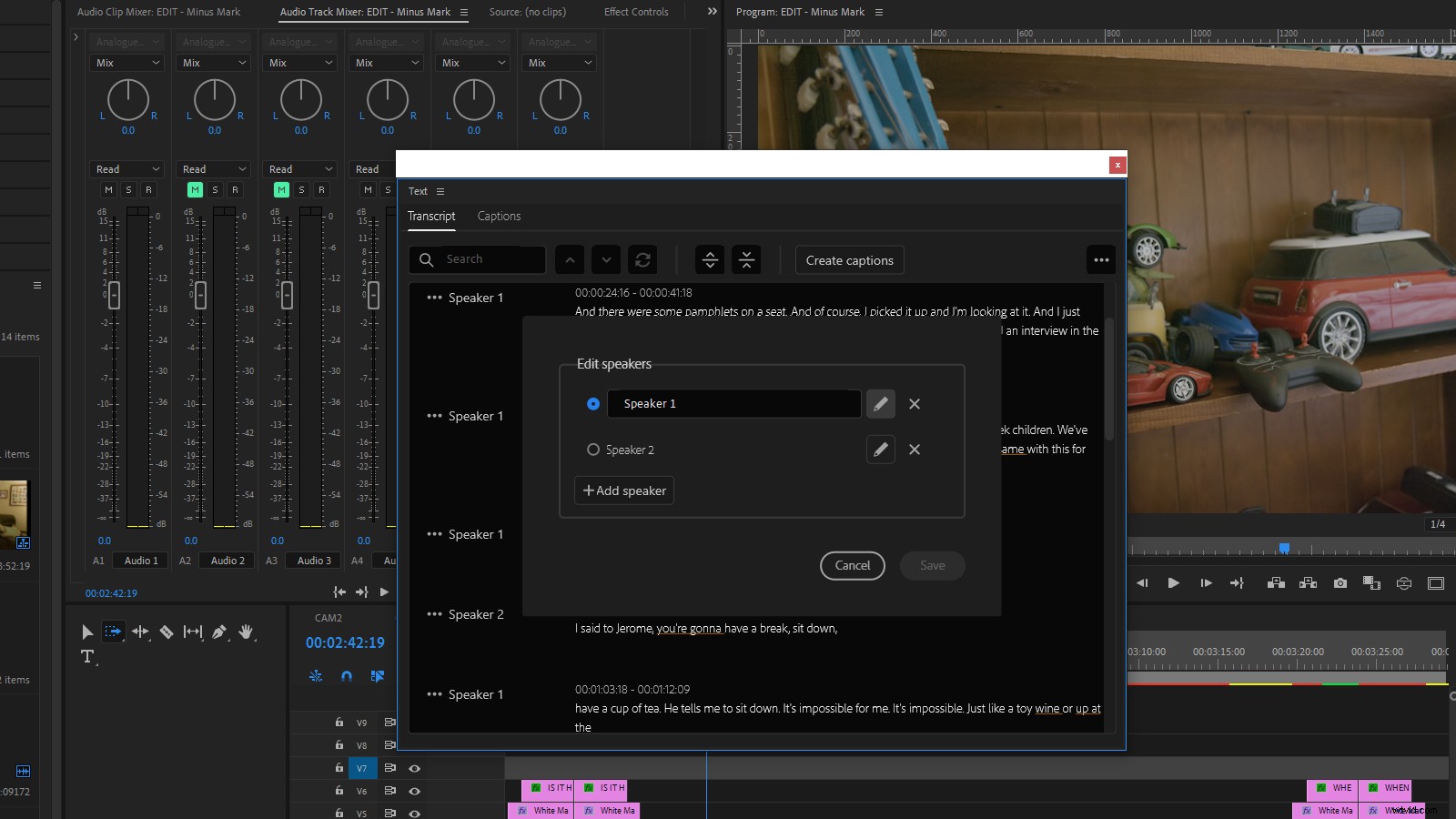

Attivando la profilazione degli oratori, Sensei riconosce più oratori, identificandoli come Relatore 1, Relatore 2, ecc. Se si annulla, verrà semplicemente elencato Sconosciuto accanto ai segmenti del paragrafo.

In ogni caso, puoi nominarli facendo clic sui puntini di sospensione nella colonna di sinistra della scheda Trascrizione e selezionando Modifica oratori.

Questo strumento ti consente di correggere manualmente i casi in cui Sensei potrebbe aver identificato in modo errato altoparlanti con voci dal suono simile e vale la pena dedicare del tempo a farlo ora prima di passare alla fase di creazione della didascalia.

Lo stesso vale per la pulizia della trascrizione. A meno che tu non sia stato estremamente fortunato con la tua analisi Speech-to-Text, ci saranno errori nella tua trascrizione. Questi sono più probabili nelle registrazioni con una consegna più colloquiale, rumore di fondo, parole non da dizionario come nomi di aziende o più oratori che parlano tra loro.

E mentre sarai in grado di modificare il testo dopo che è stato convertito in didascalie, dovresti correggere la trascrizione prima si arriva al passaggio successivo. Questo perché Premiere Pro tratta la trascrizione e i successivi sottotitoli come origini dati separate, quindi apportare modifiche a una non avrà alcun effetto sull'altra.

Quindi prenditi del tempo per ottenere la tua trascrizione corretta poiché sarà la fonte da cui verranno create tutte le tue didascalie.

Muoversi

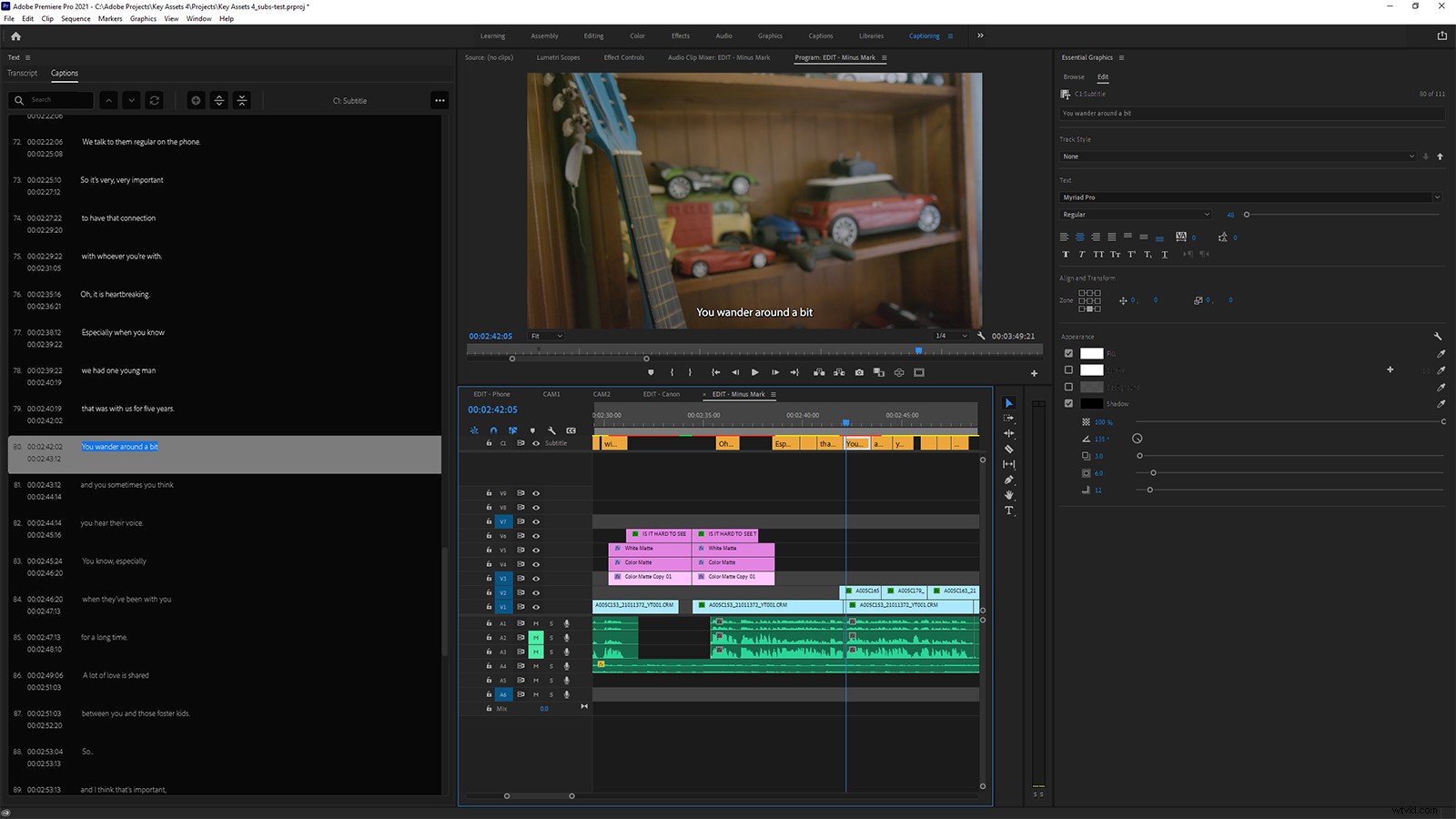

Adobe ha implementato alcune funzioni estremamente utili per aiutarti a navigare nel video e nella trascrizione allo stesso tempo.

Per cominciare, Premiere Pro dispone già di un'area di lavoro Sottotitoli che divide lo schermo in testo, grafica essenziale, sequenza temporale, contenitori di progetto e programma. Anche se potresti voler modificare le cose in base alle tue preferenze. Per me sembra così...

Una volta impostato, orientarsi è semplice.

Ad esempio, spostando la testina di riproduzione in una nuova posizione nella timeline, la trascrizione verrà automaticamente indirizzata alla posizione corrispondente, nella misura in cui la parola pronunciata in quel punto sotto la testina di riproduzione viene evidenziata in blu nel pannello Trascrizione. Qualsiasi testo che si trova prima della posizione della testina di riproduzione è colorato in grigio, un'utile aggiunta all'esperienza utente.

Allo stesso modo, la riproduzione o lo sfregamento della sequenza temporale aggiornerà la visualizzazione della trascrizione per stare al passo con l'indicatore di riproduzione.

E funziona anche al contrario, quindi selezionando una parola qualsiasi nel pannello Trascrizione sposterà automaticamente la testina di riproduzione e l'anteprima del video all'ora corrispondente nella sequenza. A volte può essere un po' lento rispondere, forse perché sta parlando con i server di Adobe, ma è comunque un approccio molto efficace.

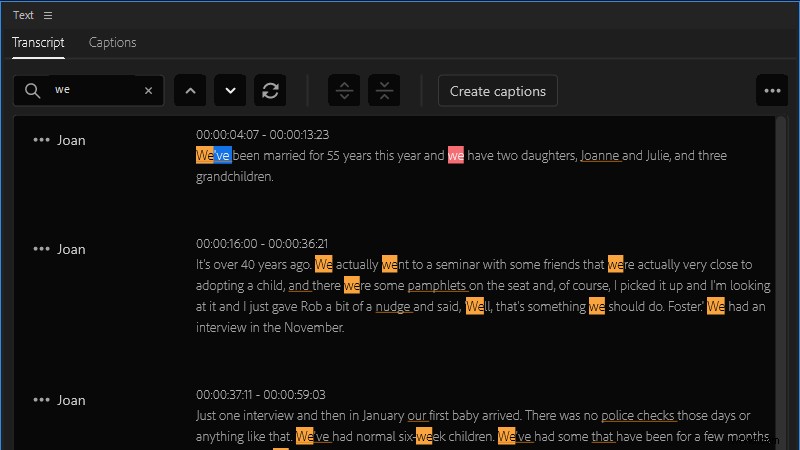

C'è anche una casella di ricerca nell'angolo in alto, che ti consente di passare a parole e frasi nella trascrizione, oltre a una funzione Sostituisci se devi correggere errori ripetuti.

Best practice

A questo punto, probabilmente farai la maggior parte della tua navigazione nel pannello Trascrizione; selezionando una parola, premendo Spazio per avviare la riproduzione, confrontando ciò che stai ascoltando con ciò che stai leggendo, quindi fermandoti e facendo doppio clic sul testo per apportare eventuali modifiche.

In base alla mia esperienza, molto probabilmente le tue modifiche si concentreranno sulla punteggiatura e sulla struttura delle frasi, piuttosto che sulla correzione di parole errate. E nonostante i migliori sforzi di Sensei, dovrai comunque impegnarti per portare le cose a uno stato pronto per la didascalia.

E questo è prevedibile. L'elaborazione del linguaggio naturale è incredibile difficile. Dopo aver preso in considerazione accenti, dialetto, manierismi, tono ed enfasi, anche gli esseri umani lottano con esso. Quindi aspettarsi risultati perfetti da una macchina non è realistico. (Ti consiglio vivamente di attivare i sottotitoli automatici di YouTube per il seguente esempio di video.)

(Questa è un'ottima alternativa – https://youtu.be/Gib916jJW1o)

Quindi avvicinati a questa fase con una mente aperta, una tazza di caffè fresca e una sedia comoda. E se hai bisogno di una guida sulle migliori pratiche per la creazione di sottotitoli, potresti voler leggere prima le linee guida dei sottotitoli della BBC.

Inoltre, ricorda che i dati della trascrizione vengono salvati nel file di progetto di Premiere Pro, quindi puoi tornarci in un secondo momento, se necessario. Puoi anche esportare la trascrizione come .prtranscript separato, ma proprietario file, anche se non è chiaro quale potrebbe essere il vantaggio di questo approccio.

Pronto?

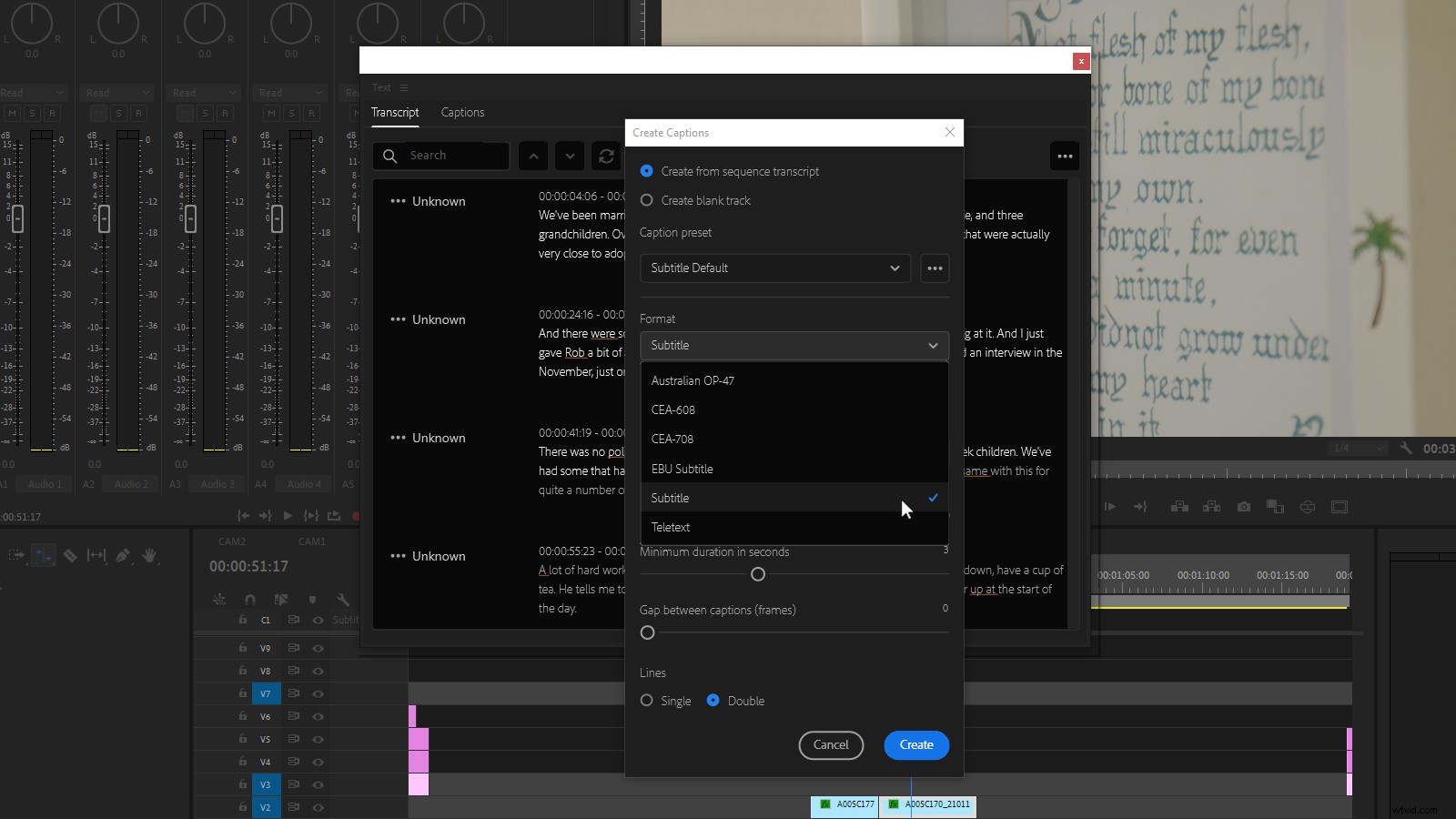

Quando sei sicuro che la tua trascrizione sia il più pulita possibile, vai avanti e fai clic su Crea didascalie pulsante.

Ti verranno fornite un sacco di opzioni qui, inclusa la possibilità di applicare gli stili (supponendo che tu ne abbia già creati alcuni). Puoi definire la lunghezza massima dei caratteri e la durata minima delle didascalie, impostarle su Riga doppia o Singola e persino il numero di fotogrammi che desideri inserire tra di loro.

Se non sei sicuro di cosa vuoi in questa fase, ti suggerisco di scegliere il formato "Sottotitoli" dal menu a discesa, assicurati che Crea dalla trascrizione della sequenza il pulsante di opzione è selezionato e lascia il resto ai valori predefiniti.

Non passerò molto tempo a discutere dei diversi formati di didascalia offerti da Speech-to-Text. In parte perché non sono un esperto delle differenze e conoscerai i requisiti del tuo progetto meglio di me. Ma soprattutto perché non ha molta importanza .

Questo perché la sintesi vocale di Premiere Pro mantiene intatti i dati della trascrizione e aggiunge i sottotitoli a una traccia separata nella sequenza temporale. (Si tratta di un enorme miglioramento rispetto al primo tentativo di didascalia di Premiere Pro, che incorporava la traccia dei sottotitoli nel livello video.)

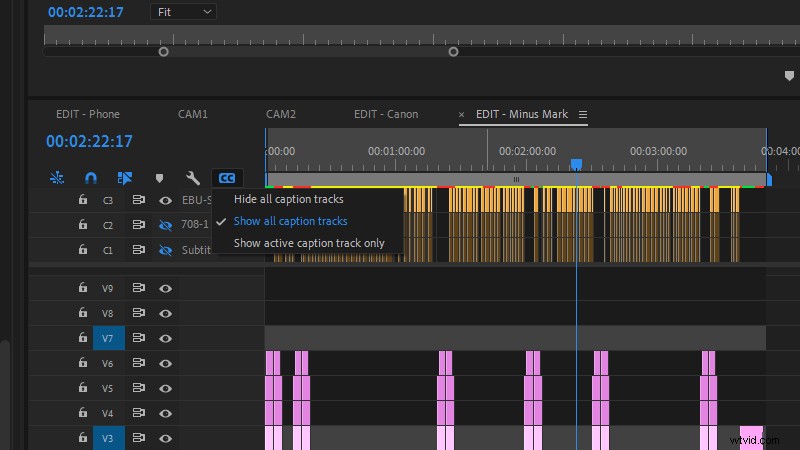

Grazie a ciò, puoi generare didascalie in tutti i formati di cui hai bisogno. Anche retroattivamente, se il tuo progetto viene venduto in un territorio che utilizza uno standard diverso. Non sembra esserci un limite al numero di tracce di sottotitoli che puoi aggiungere e il formato utilizzato per ciascuna traccia di sottotitoli è chiaramente etichettato.

Se le cose iniziano a diventare disordinate, puoi attivare o disattivare la visibilità della traccia utilizzando il pulsante CC nella visualizzazione della sequenza temporale.

Se stai lavorando con sottotitoli in lingua straniera, questo aspetto dell'interfaccia utente potrebbe essere estremamente utile, in quanto ha il potenziale per consentirti di creare livelli di sottotitoli per tutte le lingue di cui hai bisogno nella stessa sequenza temporale . Ci sono dei limiti a questo approccio, di cui parlerò più avanti, ma parlando per esperienza personale, lo accolgo con tutto il cuore.

Quindi vai avanti e premi il pulsante Crea e osserva come la tua trascrizione viene suddivisa e disposta nel formato che preferisci.

Un altro round

Se hai esperienza nella creazione di didascalie, saprai che i buoni sottotitoli richiedono una quantità sorprendente di finezza.

Non è così semplice suddividere il dialogo in frasi e mostrarle sullo schermo per tutto il tempo necessario all'interlocutore per pronunciarle.

Devi decostruire ciò che viene detto in sezioni brevi e intelligibili che possono essere lette senza distogliere troppa attenzione dalla grafica. La punteggiatura è incredibilmente importante e le interruzioni di riga possono fare la differenza tra comprensione e confusione. E per essere onesti, Speech-to-Text sembra fare un lavoro ragionevole in questo.

Tuttavia, per rispettare gli standard dei sottotitoli come quelli della FCC, è necessario trasmettere rumore e musica nella misura più ampia possibile . E mentre è irragionevole aspettarsi che Sensei inizi a etichettare rumori e musica (almeno per ora), il tuo software di sottotitoli dovrebbe consentirti di incorporare informazioni oltre il dialogo.

Uno alla volta, per favore

Sfortunatamente, la sintesi vocale è limitata a un singolo traccia senza possibilità di sovrapposizione di elementi.

Ciò significa che non c'è modo di incorporare facilmente altoparlanti simultanei o aggiungere identificatori di suoni o musica ai dialoghi. (Ho provato ad aggiungerli a una seconda traccia di sottotitoli, ma puoi abilitare la visibilità solo per una traccia alla volta.)

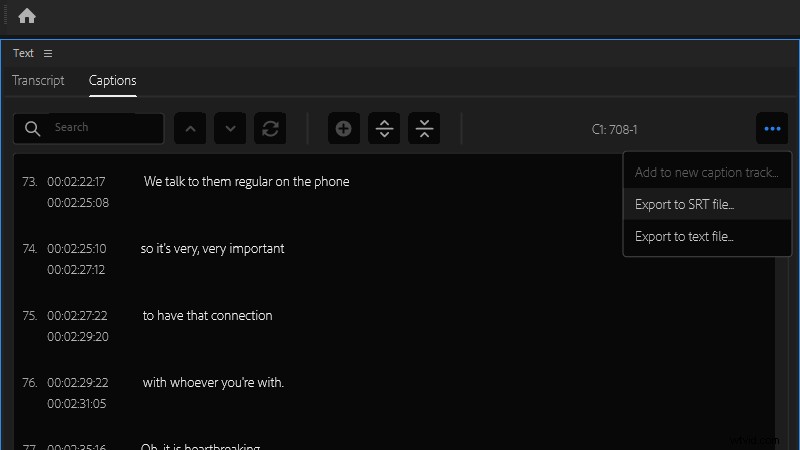

Quindi, se per il tuo progetto è necessaria la conformità FCC, potresti dover trasferire questo lavoro a un'altra soluzione per i sottotitoli. Ma anche in questo caso, puoi comunque utilizzare la sintesi vocale per ottenere la maggior parte del percorso, quindi esportare i risultati in un file di testo o SRT (SubRip) per importarli in uno strumento diverso.

Dividi la differenza

Dopo aver iniziato a modificare i sottotitoli generati da Speech-to-Text, il flusso di lavoro di Premiere Pro ha molto senso.

Le frasi sono suddivise in brevi segmenti di una sola riga che si adattano anche agli schermi più piccoli senza il ritorno a capo. E puoi scegliere di unirli o dividerli ulteriormente se non funzionano nel loro stato attuale.

È anche possibile aggiungere nuove didascalie, supponendo che ci sia spazio per farlo (l'impostazione predefinita per la didascalia inserita è di tre secondi e puoi finire per sovrascrivere le didascalie esistenti se non stai attento qui).

Anche i sottotitoli si comportano come qualsiasi altra risorsa nella sequenza temporale. Quindi puoi regolare i loro punti di attacco e stacco trascinando le maniglie delle clip, collegarle a clip video, dividerle con lo strumento Rasoio o persino eseguire modifiche di scorrimento, scorrimento, ondulazione e rollio.

Quindi, se conosci già il set di strumenti di Premiere Pro, le tue competenze esistenti ti saranno utili qui.

Risolto il problema nel post-post

Esiste, tuttavia, una limitazione alla modifica delle tracce unica per i sottotitoli.

Sebbene tu possa selezionare e manipolare più tracce video, audio o immagine contemporaneamente, solo una traccia didascalia può essere attiva in qualsiasi momento. Se devi regolare più tracce di sottotitoli in formati diversi, dovrai farlo una traccia alla volta.

Ma sembra di spaccare i capelli. Dato che il processo di inserimento dei sottotitoli in genere avviene molto tempo dopo che la modifica è stata bloccata e approvata, la necessità di apportare modifiche a più formati di sottotitoli dovrebbe essere uno scenario marginale.

Aperto o chiuso?

Premiere Pro offre un'ampia gamma di strumenti di formattazione per i sottotitoli, inclusa la possibilità di salvare gli stili e applicarli a progetti futuri.

È possibile regolare le opzioni di carattere, colore, ombra, contorno e sfondo, nonché la posizione, l'allineamento del testo e l'area utilizzabile della didascalia. E questi possono essere assegnati a singoli sottotitoli o all'intera traccia di sottotitoli.

Sottotitoli

Ma la misura in cui puoi modificare l'aspetto dei tuoi sottotitoli dipende dal fatto che intendi distribuirli come aperti o chiuso .

I sottotitoli vengono archiviati come file separati, noti anche come file collaterali, e possono essere attivati e disattivati dal visualizzatore durante la riproduzione.

La maggior parte della formattazione dei sottotitoli è gestita dal sistema di riproduzione, quindi le opzioni di formattazione sono limitate (e Premiere Pro visualizzerà solo le funzioni supportate dal formato didascalia scelto). Ma, nonostante il nome, i sottotitoli sono più facili da modificare dopo essere stati finalizzati poiché di solito sono un semplice file di testo o XML.

Sottotitoli aperti

Al contrario, i sottotitoli aperti vengono "integrati" nel video, quindi sono sempre visibili (indipendentemente dalla piattaforma o dal dispositivo di riproduzione) e puoi formattarli come meglio credi.

Significa anche che puoi creare un'unica versione del video con sottotitoli che verrà riprodotto su tutte le piattaforme video.

Ma il compromesso qui è che i tuoi sottotitoli non possono essere modificati senza eseguire nuovamente il rendering e ridistribuire l'intero video. E, se lavori con più lingue, dovresti creare video completamente nuovi per ciascuna lingua invece di un insieme più gestibile di tracce di sottotitoli.

Vale anche la pena notare che i sottotitoli aperti verranno ridimensionati insieme al video, quindi se il tuo pubblico sta guardando un elemento multimediale 16 × 9 in visualizzazione verticale su un dispositivo mobile, è possibile che i sottotitoli diventino troppo piccoli per essere letti.

Su questa base, potresti pensare che non ci sarebbe alcun motivo convincente per optare per i sottotitoli aperti sui tuoi contenuti video. Ma se pubblichi sui social media, potresti non voler fare affidamento sugli strumenti di sottotitoli automatici che sono attualmente la tua unica opzione su piattaforme come Instagram o TikTok.

Inoltre, alcune piattaforme social ti consentono di aggiungere didascalie solo contemporaneamente al caricamento del video, il che rende impossibile la pianificazione o la pubblicazione automatica di contenuti video con sottotitoli. Quindi i sottotitoli aperti possono ancora essere un'opzione praticabile.

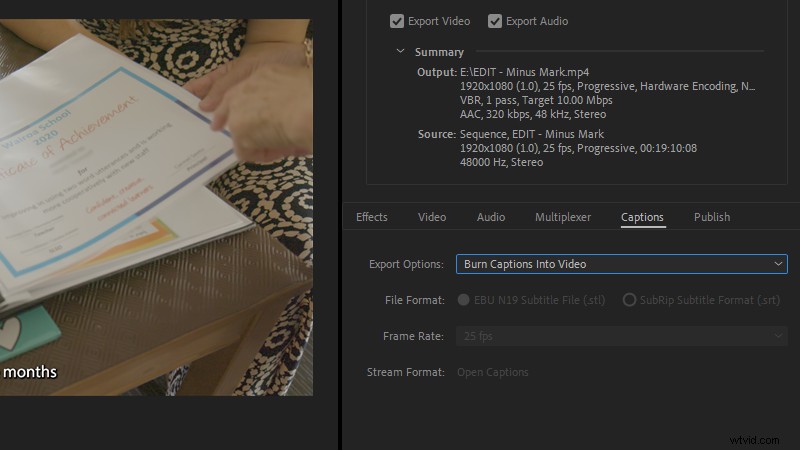

| YouTube | TikTok | ||||

| Carica didascalie | Y | Y | Y | Y | N |

| Genera automaticamente didascalie | Y | Y | N | N | Y |

| Programma video con sottotitoli | Y | Y | N | N | N |

Finitura

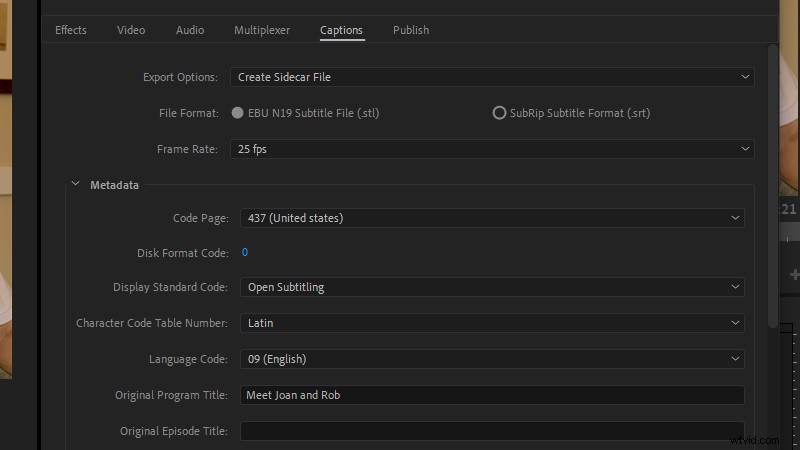

Osservando la versione attuale, sembra che le tue opzioni di esportazione siano state ridotte a EBU N19 o al file SubRip SRT di testo normale:il formato MacCaption VANC MCC e Incorpora nel file di output le opzioni trovate nella versione beta non sono più disponibili.

Tuttavia, questo non è così limitante come sembra, poiché EBU serve la maggior parte dei servizi di streaming e trasmissione e SRT copre la maggior parte delle piattaforme video online e social.

Quello che non vediamo è la possibilità di esportare solo la traccia dei sottotitoli dallo strumento di esportazione di Premiere Pro o Adobe Media Encoder, quindi è necessario eseguire il rendering di almeno un file audio per ottenere un file dei sottotitoli XML.

Dato che puoi esportare in file .srt e .txt dal pannello Didascalie, questo sembra strano e sembra destinato a cambiare in futuro.

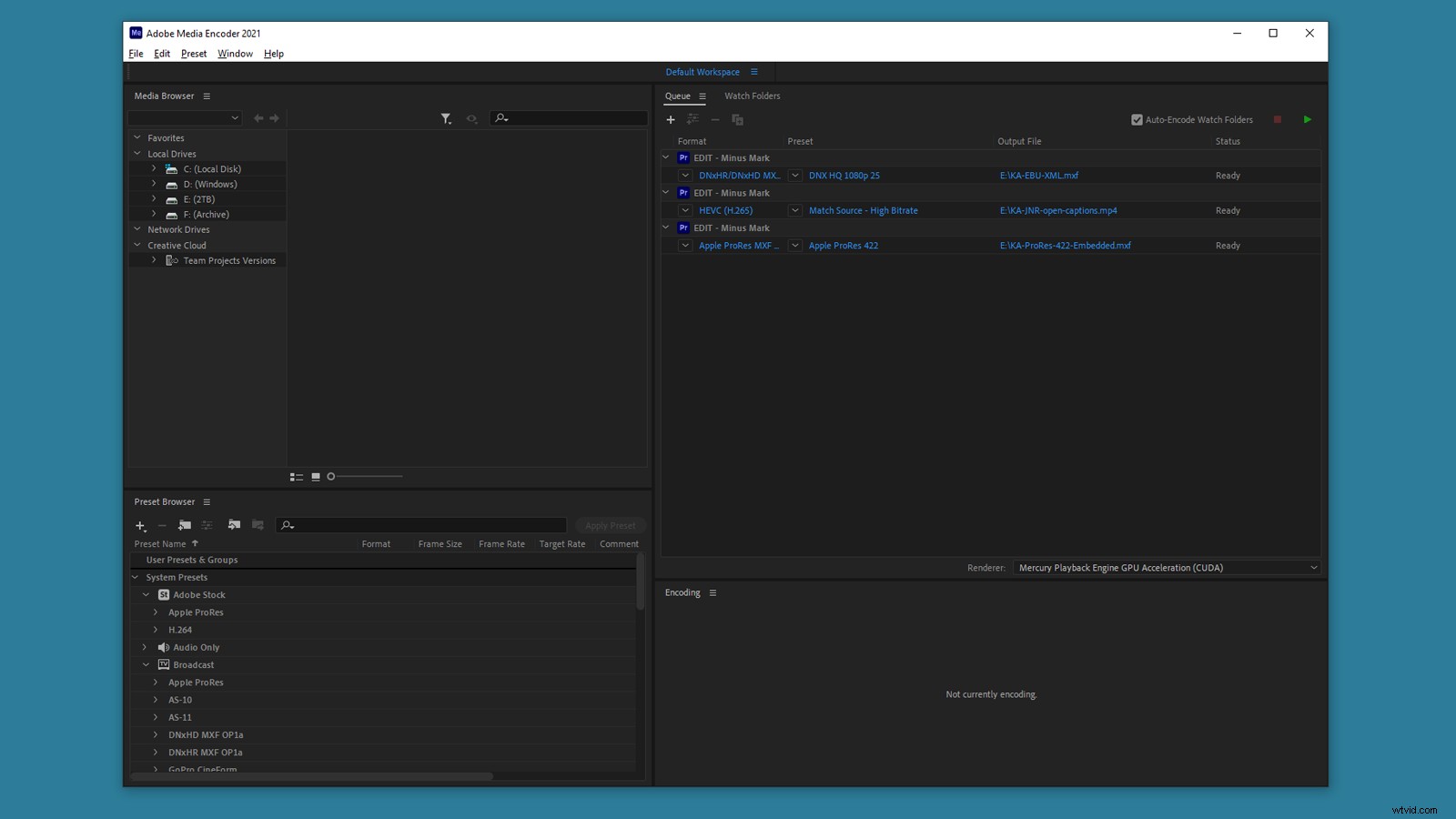

Se desideri sottotitoli aperti, puoi semplicemente selezionare Masterizza sottotitoli in video opzione. E, naturalmente, se desideri creare più esportazioni in formati diversi, puoi metterle in coda in Adobe Media Encoder per l'esportazione in batch. Assicurati solo di impostare prima la visibilità della traccia dei sottotitoli nella sequenza temporale.

Cosa manca?

Durante il test della versione beta, ho notato alcune aree in cui Adobe potrebbe migliorare questo strumento prima di rilasciarlo al pubblico e, con una piccola eccezione, sono ancora "mancanti". Quindi ecco la mia lista dei desideri:

- Dimensione del carattere regolabile nei pannelli Trascrizione e Didascalie.

La dimensione del testo è attualmente definita dalle impostazioni di sistema e a volte ho voluto aumentare la dimensione del carattere per rendere le cose più facili leggere durante la modifica della trascrizione. - Importazione di script.

Se stai lavorando con materiale con script, Speech-to-Text potrebbe, in teoria, saltare il processo di trascrizione e concentrarsi invece sui tempi. Ciò ti consentirebbe di convertire rapidamente ciò che hai già in un formato pronto per le didascalie. (YouTube lo ha già.) - Formattazione personalizzata basata sull'oratore.

Sebbene sia possibile identificare gli oratori nella trascrizione, non c'è modo di aggiungere automaticamente quei dati ai sottotitoli. E se stai sottotitolando scena per scena, potrebbe essere utile disporre di un posizionamento personalizzato dei sottotitoli per i relatori che si troveranno sempre su un lato particolare dell'inquadratura.

Ma ne vale la pena?

Non posso dire quale potrebbe essere la tua esperienza con la sintesi vocale di Premiere Pro.

È l'automazione con un solo pulsante per tutte le tue esigenze di sottotitoli? Ovviamente no. E credo che siamo ancora lontani dalla costruzione di un sistema in grado di gestire questo compito complesso e infinitamente variabile senza alcun tipo di intervento umano.

Ma per me, questo strumento è diventato un'inclusione standard nel mio toolkit prima ancora che uscisse dalla versione beta.

Se premuto, Stimerei che riduce il tempo necessario per inserire i sottotitoli a circa un terzo rispetto a prima . It’s not the only option available—Otter.ai will export transcripts to the .srt caption format, Digital Anarchy has a Premiere Pro plugin called Transcriptive, and of course, you can pay companies to do the job for you—but all of these have a cost component, while Speech-to-Text is currently free to use.

It all comes back to that comment I included at the beginning of this article—is it easier to use Speech-to-Text than it would be to transcribe it yourself? For me, the answer is a very firm yes. So if you’re looking at finding a better way to add accessibility and greater audience engagement to your video projects, Premiere Pro Speech-to-Text is definitely worth a look.

(And if you’re looking for more content on working with audio in Premiere Pro, check out Premiere Pro Mixing Basics and Premiere Pro Audio Tools.)